El término cracker (del inglés cracker, y este de to crack,

‘romper’, ‘quebrar’) se utiliza para referirse a las personas que

"rompen" algún sistema de seguridad. Los crackers pueden estar

motivados por una multitud de razones, incluyendo fines de lucro, protesta, o

por el desafío. Mayormente, se entiende que los crackers se dedican a la

edición desautorizada de software propietario. Sin embargo, debe entenderse que

si bien los ejecutables binarios son uno de los principales objetivos de estas

personas, una aplicación web o cualquier otro sistema informático representan

otros tipos de ataques que de igual forma pueden ser considerados actos de

cracking.

miércoles, 24 de junio de 2015

Cookie

Una cookie (o galleta informática) es una pequeña

información enviada por un sitio web y almacenada en el navegador del usuario,

de manera que el sitio web puede consultar la actividad previa del usuario.

Sus principales funciones son:

Llevar el control de usuarios: cuando un usuario introduce

su nombre de usuario y contraseña, se almacena una cookie para que no tenga que

estar introduciéndolas para cada página del servidor. Sin embargo, una cookie

no identifica a una persona, sino a una combinación de

computador-navegador-usuario.

Conseguir información sobre los hábitos de navegación del

usuario, e intentos de spyware (programas espía), por parte de agencias de

publicidad y otros. Esto puede causar problemas de privacidad y es una de las

razones por la que las cookies tienen sus detractores.

Ciberespacio

Se refiere a un entorno no físico creado por equipos de

cómputo unidos para interoperar en una red. En el ciberespacio, los operadores

del equipo pueden interactuar de manera similar al mundo real, a excepción que

la interacción en el ciberespacio no requiere del movimiento físico más allá

que el de escribir. La información se puede intercambiar en tiempo real o en

tiempo diferido, y la gente puede comprar, compartir, explorar, investigar,

trabajar o jugar.

Memoria caché

Una memoria caché es una memoria en la que se almacenas una

serie de datos para su rápido acceso.

Hay tres tipos diferentes de memoria caché para

procesadores:

Caché de 1er nivel

(L1):

Esta caché está integrada en el núcleo del procesador, trabajando a la misma velocidad que este. La cantidad de memoria caché L1 varía de un procesador a otro, estando normalmente entra los 64KB y los 256KB. Esta memoria suele a su vez estar dividida en dos partes dedicadas, una para instrucciones y otra para datos.

Caché de 2º nivel

(L2):

Integrada también en el procesador, aunque no directamente en el núcleo de este, tiene las mismas ventajas que la caché L1, aunque es algo más lenta que esta. La caché L2 suele ser mayor que la caché L1, pudiendo llegar a superar los 2MB. A diferencia de la caché L1, esta no está dividida, y su utilización está más encaminada a programas que al sistema.

Caché de 3er nivel

(L3):

Es un tipo de memoria caché más lenta que la L2, muy poco utilizada en la actualidad. En un principio esta caché estaba incorporada a la placa base, no al procesador, y su velocidad de acceso era bastante más lenta que una caché de nivel 2 o 1, ya que si bien sigue siendo una memoria de una gran rapidez (muy superior a la RAM, y mucho más en la época en la que se utilizaba), depende de la comunicación entre el procesador y la placa base. Para hacernos una idea más precisa de esto, imaginemos en un extremo el procesador y en el otro la memoria RAM. Pues bien, entre ambos se encuentra la memoria caché, más rápida cuanto más cerca se encuentre del núcleo del procesador (L1). Las memorias caché son extremadamente rápidas (su velocidad es unas 5 veces superior a la de una RAM de las más rápidas), con la ventaja añadida de no tener latencia, por lo que su acceso no tiene ninguna demora... pero es un tipo de memoria muy cara. Esto, unido a su integración en el procesador (ya sea directamente en el núcleo o no) limita bastante el tamaño, por un lado por lo que encarece al procesador y por otro por el espacio disponible. En cuanto a la utilización de la caché L2 en procesadores multinucleares, existen dos tipos diferentes de tecnologías a aplicar. Por un lado está la habitualmente utilizada por Intel, que consiste en que el total de la caché L2 está accesible para ambos núcleos y por otro está la utilizada por AMD, en la que cada núcleo tiene su propia caché L2 dedicada solo para ese núcleo. La caché L2 apareció por primera vez en los Intel Pentium Pro, siendo incorporada a continuación por los Intel Pentium II, aunque en ese caso no en el encapsulado del procesador, sino externamente (aunque dentro del procesador)

Codecs

Códec es una abreviatura de Codificador-Descodificador.

Describe una especificación desarrollada en software, hardware o una

combinación de ambos, capaz de transformar un archivo con un flujo de datos o una señal. Los códecs pueden codificar el flujo o la señal (a menudo

para la transmisión, el almacenaje o el cifrado) y recuperarlo o descifrarlo

del mismo modo para la reproducción o la manipulación en un formato más

apropiado para estas operaciones. Los códecs son usados a menudo en

videoconferencias y emisiones de medios de comunicación.

Browser

Un navegador o navegador web (del inglés, web browser) es

una aplicación que opera a través de Internet, interpretando la información de

archivos y sitios web para que podamos ser capaces de leerla, (ya se encuentre

ésta alojada en un servidor dentro de la World Wide Web o en un servidor

local).

La funcionalidad básica de un navegador web es permitir la

visualización de documentos de texto, posiblemente con recursos multimedia

incrustados. Los documentos pueden estar ubicados en la computadora en donde

está el usuario, pero también pueden estar en cualquier otro dispositivo que

esté conectado a la computadora del usuario o a través de Internet, y que tenga

los recursos necesarios para la transmisión de los documentos (un software

servidor web).

Bus

Conjunto de conexiones físicas (cables, placa de circuito impreso, etc.) que pueden compartirse con múltiples componentes de hardware para que se comuniquen entre sí. El propósito de los buses es reducir el número de rutas necesarias para la comunicación entre los distintos componentes, al realizar las comunicaciones a través de un solo canal de datos. Ésta es la razón por la que, a veces, se utiliza la metáfora "autopista de datos".

Buffer de datos

Es un espacio de la memoria en un

disco o en un instrumento digital reservado para el almacenamiento temporal de

información digital, mientras que está esperando ser procesada. Por ejemplo, un

analizador TRF tendrá uno o varios buffers de entrada, donde se guardan las

palabras digitales que representan las muestras de la señal de entrada. El

Z-Buffer es el usado para el renderizado de imágenes 3D.

Boolean

Booleano. Símbolos utilizados para la relación entre

términos matemáticos, variables, etc. Por ejemplo: AND, OR, XOR, etc. Son

utilizados también en los buscadores para precisar las búsquedas.

Lenguajes de programación

Es un lenguaje diseñado para describir el conjunto de

acciones consecutivas que un equipo debe ejecutar. Por lo tanto, un lenguaje de

programación es un modo práctico para que los seres humanos puedan dar

instrucciones a un equipo.

Por otro lado, el término "lenguaje natural"

define un medio de comunicación compartido por un grupo de personas (por

ejemplo: inglés o francés).

Tipos de lenguaje de

programación

Lenguajes de máquina: En informática, cualquier lenguaje artificial que puede

utilizarse para definir una secuencia de instrucciones para su procesamiento

por un ordenador o computadora. Es complicado definir qué es y qué no es un

lenguaje de programación. Se asume generalmente que la traducción de las

instrucciones a un código que comprende la computadora debe ser completamente

sistemática. Normalmente es la computadora la que realiza la traducción.

Lenguaje de bajo nivel: Se llaman de bajo nivel porque están muy cercanos

al hardware del ordenador. Es necesario conocer a fondo la arquitectura de la máquina

para la que se va a programar. El primer lenguaje de este tipo que se utilizó

fue el lenguaje máquina, que consiste en un conjunto de instrucciones en

binario, es decir, con ceros y unos, con los cuales se indica al ordenador qué

hacer. Este lenguaje es muy complicado y la posibilidad de cometer errores es

muy alta, por lo que ya no se utiliza. Para solventar estas dificultades

apareció el lenguaje ensamblador, que consiste en asignar una abreviatura a

cada instrucción en binario, de forma que sea más fácil recordarla y más

difícil equivocarse. Sin embargo, con este lenguaje sigue siendo necesario

conocer muy bien el hardware del ordenador.

Lenguajes de alto nivel: Los primeros programas ensambladores producían sólo una

instrucción en lenguaje de máquina por cada instrucción del programa fuente.

Para agilizar la codificación, se desarrollaron programas ensambladores que

podían producir una cantidad variable de instrucciones en lenguaje de máquina

por cada instrucción del programa fuente.

Lenguajes compilados: En informática, un lenguaje cuyos programas se traducen a

código máquina antes de ejecutarse, a diferencia de un lenguaje interpretado,

cuyos programas se traducen y ejecutan instrucción por instrucción.

Lenguajes interpretados: Se puede también utilizar una alternativa diferente de los

compiladores para traducir lenguajes de alto nivel. En vez de traducir el

programa fuente y grabar en forma permanente el código objeto que se produce

durante la corrida de compilación para utilizarlo en una corrida de producción

futura, el programador sólo carga el programa fuente en la computadora junto

con los datos que se van a procesar.

Lenguajes de programación declarativos: Se les conoce como lenguajes declarativos en ciencias

computacionales a aquellos lenguajes de programación en los cuales se le indica

a la computadora qué es lo que se desea obtener o qué es lo que se está

buscando, por ejemplo: Obtener los nombres de todos los empleados que tengan

más de 32 años. Eso se puede lograr con un lenguaje declarativo como SQL.

Lenguaje de descripción de máquina: Lenguaje de programación, como el PostScript, que se utiliza

para describir la salida a una impresora o a una pantalla, que a su vez usan

las instrucciones del lenguaje de descripción de página para construir el texto

y los gráficos para crear la imagen de la página. El lenguaje de descripción de

página es como otros lenguajes de ordenador o computadora, con un flujo lógico

de programa que permite una manipulación sofisticada de la salida.

Lenguajes Algorítmicos

Un algoritmo se define como un método que se realiza

paso a paso para solucionar un problema que termina en un número finito de

pasos. Es una serie de símbolos y reglas que se utilizan para describir de manera explicita un proceso.

Las características fundamentales que debe cumplir todo

algoritmo son:

- Debe ser preciso e indicar el orden de realización de cada paso.

- Debe ser definido. Si se sigue un algoritmo dos veces, se debe obtener el mismo resultado cada vez.

- Debe ser finito. Si se sigue un algoritmo, se debe terminar en algún momento; o sea debe tener un número finito de pasos.

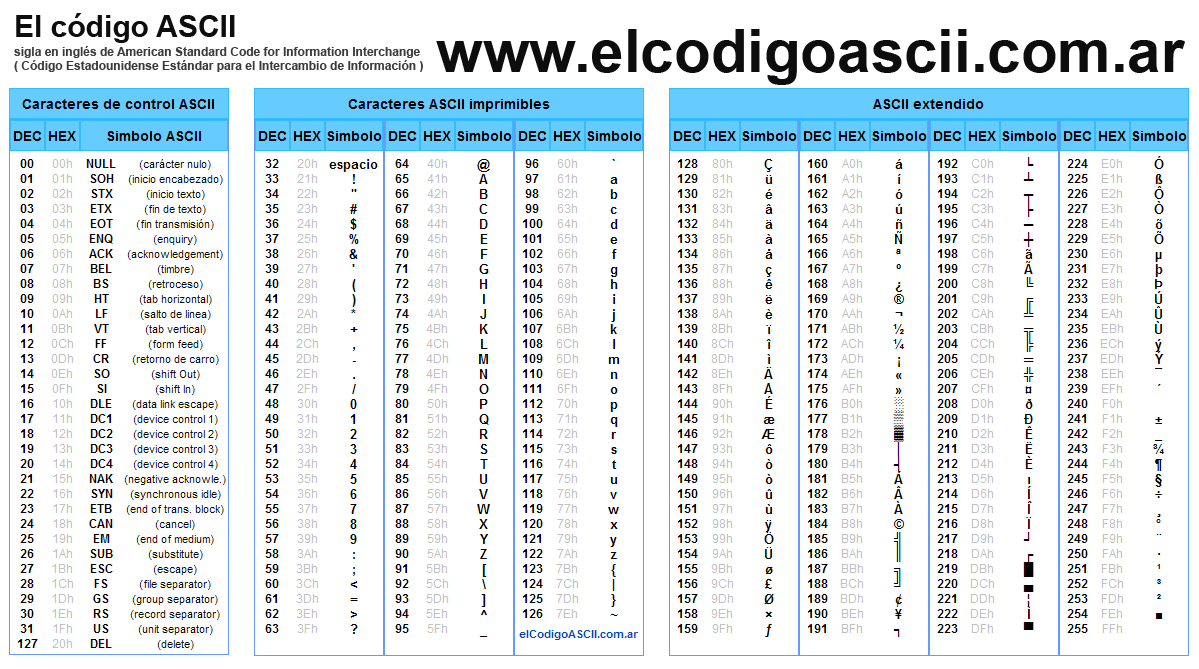

Lenguaje ASCII

Breve historia del Código ASCII :

El código ASCII (siglas en inglés para American Standard

Code for Information Interchange, es decir Código Americano Estándar para el

intercambio de Información se pronuncia Aski.

Fue creado en 1963 por el Comité Estadounidense de

Estándares o "ASA", este organismo cambio su nombre en 1969 por

"Instituto Estadounidense de Estándares Nacionales" o

"ANSI" como se lo conoce desde entonces.

Este código nació a partir de reordenar y expandir el

conjunto de símbolos y caracteres ya utilizados en aquel momento en telegrafía

por la compañía Bell. En un primer momento solo incluía letras mayúsculas y

números, pero en 1967 se agregaron las letras minúsculas y algunos caracteres

de control, formando así lo que se conoce como US-ASCII, es decir los

caracteres del 0 al 127.

Así con este conjunto de solo 128 caracteres fue publicado

en 1967 como estándar, conteniendo todos lo necesario para escribir en idioma inglés.

En 1981, la empresa IBM desarrolló una extensión de 8 bits

del código ASCII, llamada "página de código 437", en esta versión se

reemplazaron algunos caracteres de control obsoletos, por caracteres gráficos.

Además se incorporaron 128 caracteres nuevos, con símbolos, signos, gráficos

adicionales y letras latinas, necesarias para la escrituras de textos en otros

idiomas, como por ejemplo el español. Así fue como se sumaron los caracteres

que van del ASCII 128 al 255.

IBM incluyó soporte a esta página de código en el hardware

de su modelo 5150, conocido como "IBM-PC", considerada la primera

computadora personal. El sistema operativo de este modelo, el

"MS-DOS" también utilizaba el código ASCII extendido.

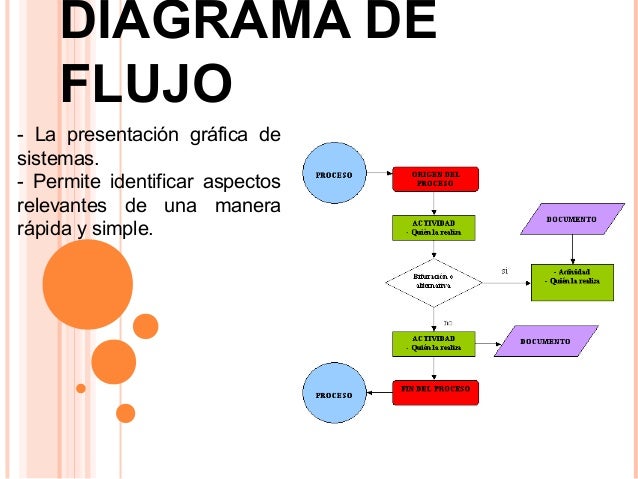

Diagrama de flujo

El diagrama de flujo o diagrama de actividades es la

representación gráfica del algoritmo o proceso. Se utiliza en disciplinas como

programación, economía, procesos industriales y psicología cognitiva.

En Lenguaje Unificado de Modelado (UML), un diagrama de

actividades representa los flujos de trabajo paso a paso de negocio y

operacionales de los componentes en un sistema. Un diagrama de actividades

muestra el flujo de control general.

En SysML el diagrama ha sido extendido para indicar flujos

entre pasos que mueven elementos físicos (p.ej., gasolina) o energía (p.ej.,

presión). Los cambios adicionales permiten al diagrama soportar mejor flujos de

comportamiento y datos continuos.

Redes de computadoras

Una red es un conjunto de dos o más computadoras conectadas

entre sí, para compartir recursos (impresora) e información.

Dentro del área de las redes computacionales, se le denomina

nodo, a cada una de las computadoras que integra dicha red.

Tipos de redes

Las redes computacionales se clasifican, según su tamaño, de

la siguiente manera:

- Redes LAN (Local Area Network). Redes de área local, este tipo de redes son relativamente pequeñas, esto quiere decir que las podemos encontrar en oficinas, escuelas, mercados, cualquier organización establecida dentro de un mismo edificio. Como abarcan un área geográfica pequeña, el tiempo de transmisión no es mucho.

- Redes WAN (Wide Area Network). Redes de área extensa, como su nombre lo indica, abarcan una amplia área geográfica, es decir, países o continentes, lo que hace la transmisión de datos más lenta que las LAN. Interconectan equipos dispersos, generalmente, a estas redes se conectan las tipo LAN, para tener acceso a mejores servicios.

- Redes MAN (Metropolitan Área Network). Redes de área metropolitana, cubren un área geográfica determinada; pueden interconectar dos o más redes LAN.

Sistemas Operativos

Es el programa o software más importante de un ordenador.

Para que funcionen los otros programas, cada ordenador de uso general debe

tener un sistema operativo. Los sistemas operativos realizan tareas básicas,

tales como reconocimiento de la conexión del teclado, enviar la información a

la pantalla, no perder de vista archivos y directorios en el disco, y controlar

los dispositivos periféricos tales como impresoras, escáner, etc.

En sistemas grandes, el sistema operativo tiene incluso

mayor responsabilidad y poder, se asegura de que

los programas y usuarios que están funcionando al mismo tiempo no interfieran

entre ellos. El sistema operativo también es responsable de la seguridad,

asegurándose de que los usuarios no autorizados no tengan acceso al sistema.

Los sistemas

operativos se clasifican en:

Multiusuario:

Permite que dos o más usuarios utilicen sus programas al mismo tiempo. Algunos

sistemas operativos permiten a centenares o millares de usuarios al mismo

tiempo.

Multiprocesador:

soporta el abrir un mismo programa en más de una CPU.

Multitarea:

Permite que varios programas se ejecuten al mismo tiempo.

Multitramo:

Permite que diversas partes de un solo programa funcionen al mismo tiempo.

Tiempo Real:

Responde a las entradas inmediatamente. Los sistemas operativos como DOS y

UNIX, no funcionan en tiempo real.

Suscribirse a:

Entradas (Atom)